Virginia Eubanks, autora del libro “Automating inequality” -sobre la desigualdad que reproducen los algoritmos y los sistemas automáticos- participó del podcast “The Received Wisdom”, realizado por la profesora de Políticas Públicas de la Universidad de Michigan, Dra. Shobita Parthasarathy, y el profesor del Departamento de Estudios de Ciencia y Tecnología de la University College London, Dr. Jack Stilgoe.

En el episodio 8, titulado “Facial Recognition, Algorithmic Inequality, and a Racial Reckoning” (Reconocimiento facial, desigualdad algorítmica y un ajuste de cuentas racial), los conductores conversaron sobre las decisiones de las grandes compañías de tecnología -las big tech (IBM, Microsoft y Amazon)- de retirarse de la tecnología de reconocimiento facial (como herramienta policial, al menos por un tiempo) y sobre la influencia del movimiento Black Lives Matter en la ciencia y la tecnología en general.

Allí dijo: “Quiero ver herramientas profundamente no objetivas, profundamente no neutrales, en este espacio. Quiero ver herramientas que se construyan con valores democráticos básicos, importantes y cruciales desde que se los piensa al principio”.

Eubanks relata que la investigación que derivó en su más famoso libro comenzó en 1999-2000 cuando se mudó a la ciudad de Troy, Nueva York y comenzó a trabajar en el desarrollo de capacidades tecnológicas en una comunidad de 90 mujeres pobres de clase trabajadora que vivían en una residencia de YWCA. La idea que ella tenía sobre el acceso a la tecnología por parte de esas mujeres, cuenta, era muy distinta a la realidad que ellas le contaron. Le sugirieron que esa forma de pensar acerca de la tecnología y la justicia no coincidía con su experiencia.

“Lo que me dijeron fue que esta idea de que el problema era que no tenían acceso a la tecnología simplemente no era cierta. Esa tecnología digital era totalmente omnipresente en sus vidas, en el sistema de justicia penal y en el tipo de economía de bajos salarios en la vivienda pública en todas las diferentes áreas de su vida. Pero la realidad era que su experiencia con la tecnología era realmente bastante explotadora y extractiva”.

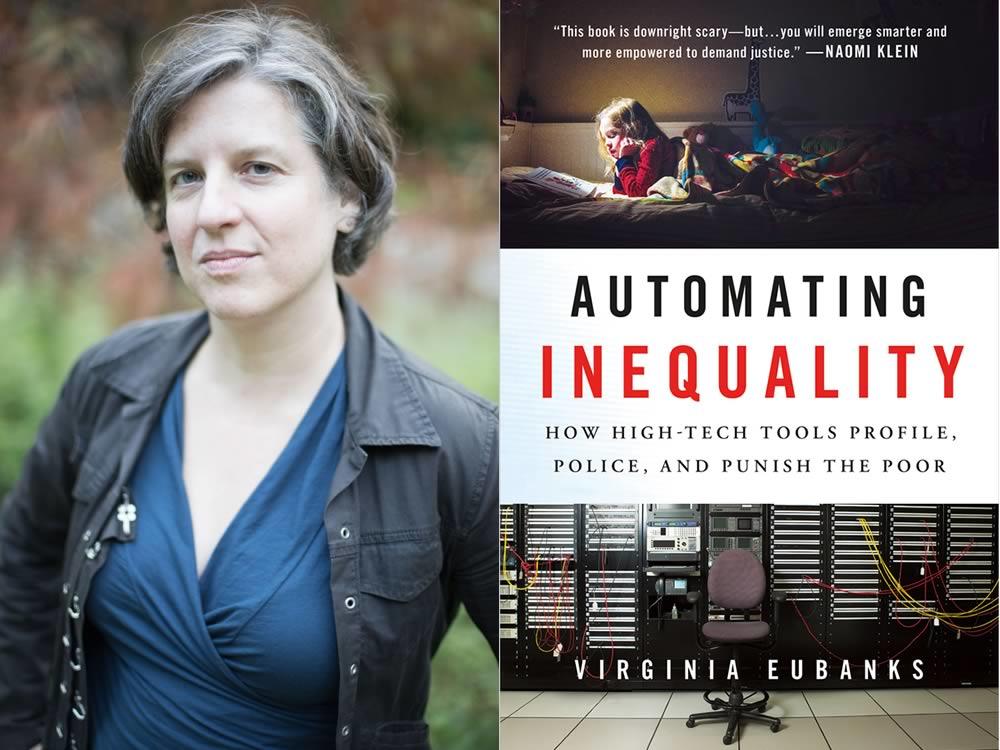

Virginia Eubanks

Así fue como comenzó a indagar en cómo es la interacción con la tecnología en su vida cotidiana. Sobre los debates actuales en torno a la ética y las políticas de la Inteligencia Artificial, reflexiona:

“Deberíamos estar pensando en ello, pero de alguna manera las conversaciones sobre la ética y la política de la IA se ven atrapadas en qué podría suceder, cuando siento que las mujeres con las que he estado trabajando en los derechos de bienestar y en la organización de la tecnología en la comunidad durante dos décadas está realmente lista para decir qué es lo que ya está sucediendo y ha estado sucediendo desde los años setenta”.

Virginia Eubanks

La invasión de tecnologías de Inteligencia Artificial en todos los ámbitos de la vida cotidiana de las personas es tema de la agenda periodística de los últimos años, cada vez con mayor intensidad, al igual que los debates, eventos y textos sobre la importancia de definir una “ética de la IA” o diseñar la regulación y las políticas públicas necesarias para esta nueva tecnología que se impone casi sin discusiones previas. Estos debates se reforzaron a partir de los sistemas de reconocimiento facial utilizados en Londres o California, o a partir de sistemas que discriminan a mujeres (como el caso del sistema que seleccionaba candidatos para trabajar en Amazon) o personas de diversas etnias (como los sistemas de reconocimiento facial expuestos por la organización The Coded Gaze).

Sin embargo, es por esto que miradas como la de Virginia Eubanks, que viene trabajando con esto desde hace más de 20 años, se hacen relevantes, ya que da cuenta de que esta forma de implementar la tecnología no es algo nuevo sino que es algo que ha comenzado hace más de dos décadas, sólo que ahora se masificó a todos los estratos sociales. Es necesario reflexionar sobre lo que ya ha estado sucediendo, sus impactos en la sociedad y cuáles deben ser las regulaciones y políticas para contrarrestar los efectos de la tecnología que profundizan las desigualdades existentes en la sociedad.

El episodio completo puede escucharse acá: https://shobitap.org/the-received-wisdom/2020/6/30/episode-8-facial-recognition-algorithmic-inequality-and-a-racial-reckoning-ft-virginia-eubanks

También puede leerse la transcripción: https://docs.google.com/document/d/1wsFOwbE4dH8JyqfAUsQ8rLwvttzPhW6SyufzJaVVEAE/edit#